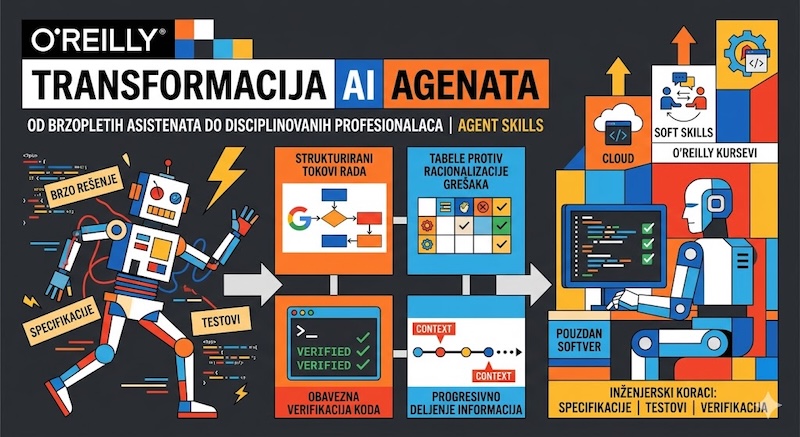

Ovaj video prikazuje intervju sa Andersom Hejlsbergom, legendarnim tvorcem programskih jezika C# i TypeScript, koji deli svoje viđenje budućnosti softverskog inženjeringa u eri veštačke inteligencije. On izražava snažan skepticizam prema ideji da će veštačka inteligencija zameniti programere, ističući da ona ne može da inovira niti da zameni duboko razumevanje sistemske arhitekture i osnovnih principa. Hejlsberg objašnjava istoriju nastanka svojih jezika i naglašava da je AI zapravo akcelerator koji uklanja zamorne zadatke, dok kreativni dizajn i dalje ostaje u domenu ljudskog uma. Autor savetuje početnike da se fokusiraju na osnove programiranja i rad na projektima otvorenog koda kako bi izgradili kredibilitet. Na kraju, on zaključuje da obrazovanje i strast ostaju ključ...