Zašto rečitost veštačke inteligencije nije isto što i ljudsko rasuđivanje

Zamislite da zakoračite u lekarsku ordinaciju i poverite svoje zdravlje stručnjaku čiji su dijagnostički zaključci besprekorni. Njegov rečnik je precizan, ton umirujući, a objašnjenja odišu autoritetom. Ipak, ubrzo otkrivate činjenicu koja menja sve: taj lekar nikada u životu nije dotakao ljudsko telo. On ne poznaje osećaj pulsa pod prstima, niti razliku između bola koji zrači i onog koji pulsira kroz neposredno iskustvo. On je samo pročitao milione medicinskih izveštaja i do savršenstva naučio kako jedna dijagnoza treba da „zvuči“.

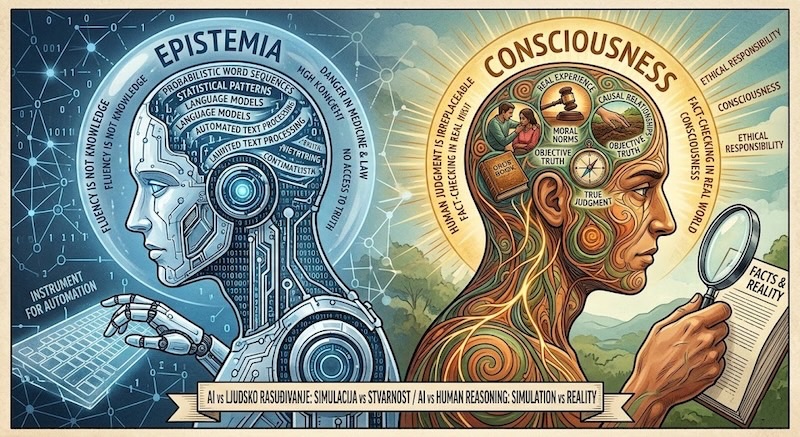

Onog trenutka kada shvatite da se njegovo znanje sastoji od tekstualnih obrazaca, a ne od kontakta sa fizičkim svetom, poverenje se urušava. Ovaj scenario nije samo misaoni eksperiment; on je ogledalo našeg odnosa sa velikim jezičkim modelima (LLM) poput ChatGPT-a. Suočavamo se sa dubokim paradoksom – mašinom koja poseduje zadivljujuću jezičku tečnost, ali čije je „znanje“ lišeno bilo kakvog dodira sa stvarnošću na koju se to znanje odnosi.

Ljudsko rasuđivanje protiv lingvističke korelacije

Kada čovek ocenjuje kredibilitet informacije, on ne analizira samo reči, već aktivira složenu mrežu kognitivnih procesa. Mi proveravamo činjenice u odnosu na ono što znamo o svetu, procenjujemo reputaciju izvora i analiziramo logički sled događaja. Međutim, ljudsko prosuđivanje ima i biološko sidro: mi se oslanjamo na lično iskustvo i emocije, na one intuitivne osećaje o istini koji su oblikovani godinama života u fizičkom i društvenom prostoru.

Veštačka inteligencija funkcioniše na radikalno drugačijem principu – lingvističkoj korelaciji. Umesto da se oslanja na spoljne činjenice ili proživljeno iskustvo, model analizira distribuciju reči. On izračunava verovatnoću kojom se određene kombinacije reči pojavljuju zajedno. Opasnost je suptilna i prikrivena: AI može doneti ispravan zaključak, ali iz potpuno pogrešnih razloga. Dok čovek teži istini, mašina samo popunjava lingvističku siluetu te istine, pretvarajući prosuđivanje u puko predviđanje sledećeg znaka u nizu.

Iluzija morala: Kada AI simulira deliberaciju

U domenu etike i moralnih dilema, veštačka inteligencija pokazuje gotovo sablasnu sposobnost imitacije. Ona koristi vokabular dužnosti, prava i brige, pa čak i konstruiše „ako-onda“ scenarije koji simuliraju uzročno-posledičnu logiku. Ipak, ova simulacija ne podrazumeva svest o posledicama.

Za razliku od ljudi, koji koriste moralne norme i emotivne reakcije na bol ili nepravdu kako bi zamislili različite ishode, AI ne zamišlja ništa. Ona samo reprodukuje obrasce o tome kako ljudi pišu o moralu.

„Proces iza AI-a je 'popunjavanje obrazaca' (pattern completion), a ne razumevanje kako događaji zapravo proizvode ishode u stvarnom svetu.“

Kada mašina „razmišlja“ o uzročnosti, ona ne analizira stvarnu moć jednog događaja da izazove drugi, već koristi statističku analogiju prethodnih tekstova. To je rezonovanje bez razuma; forma bez suštine.

Epistemija: Zamka u koju svesno upadamo

Naša sklonost da verujemo ovim modelima nije greška u kodu, već u našoj sopstvenoj kognitivnoj arhitekturi. Ljudski mozak je evolutivno programiran da veruje tečnom izražavanju (fluency). Što je informacija lakša za procesuiranje i što „glatkije“ zvuči, to smo skloniji da je prihvatimo kao istinitu.

Ovaj fenomen naučnici nazivaju epistemija. To nije svojstvo veštačke inteligencije, već mana u načinu na koji ljudi interpretiraju ove modele, pri čemu se jezička uverljivost uzima kao surogat za istinu.

Epistemija nas navodi da elokvenciju pobrkamo sa uvidom. Budući da je AI model elokventan, mi mu instinktivno pripisujemo unutrašnje stanje – verovanja, namere i svest o istini. Međutim, model ne može da revidira svoja uverenja niti da proveri svoje tvrdnje u odnosu na stvarnost, jer on ne poseduje koncept istine. On samo poseduje verovatnoću.

Mašina za automatizaciju, a ne za razumevanje

LLM modele treba tretirati kao ono što oni suštinski jesu: pogoni lingvističke automatizacije. Oni su izuzetni u draftovanju, sumiranju i kreativnom rekombinovanju ideja. Međutim, njihova upotreba postaje kritično opasna u sferama poput prava, medicine ili psihologije, gde je istina važnija od puke uverljivosti.

Kada od mašine tražimo da donese presudu ili postavi dijagnozu, mi vršimo tihu i opasnu redefinaciju samog pojma prosuđivanja. Prosuđivanje prestaje da bude odnos između ljudskog uma i stvarnog sveta i postaje odnos između korisničkog upita (prompta) i distribucije verovatnoće. Time se prosuđivanje lišava odgovornosti i kontakta sa realnošću, pretvarajući ga u statistički nusproizvod.

Zaključak: Rečitost nije dokaz razuma

Veštačku inteligenciju ne treba posmatrati sa strahom, već sa trezvenim razumevanjem njenih ograničenja. Ona je sofisticiran lingvistički instrument, ali instrument koji zahteva stalni ljudski nadzor jer mu nedostaje pristup domenu od kojeg svako prosuđivanje zavisi: samom svetu.

Glatkoća izražavanja nije dokaz dubine, a rečitost nije dokaz razuma. Dok integrišemo ove alate u svoju svakodnevicu, moramo se zapitati: da li smo zaista spremni da zamenimo neurednu, proživljenu i emotivnu istinu ljudskog iskustva za sterilnu, ispoliranu pogodnost distribucije verovatnoće?

Izvor: scientificamerican.com

Komentari

Nema komentara. Šta vi mislite o ovome?