Zašto je Qwen3.5-9B-Claude-4.6-Opus-v2 prekretnica za lokalni AI

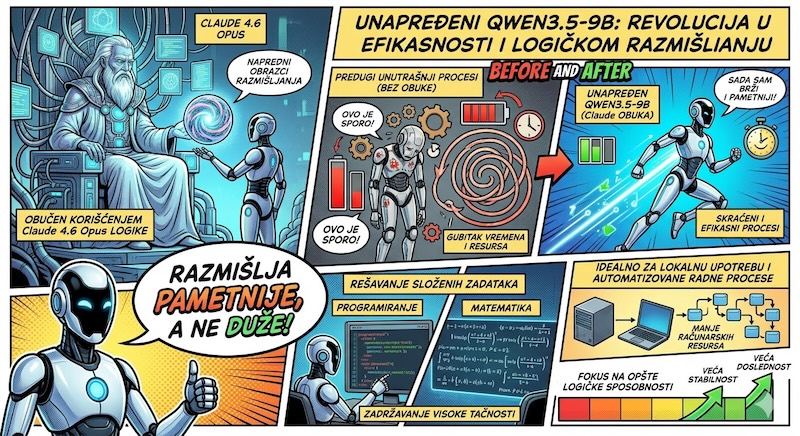

U svetu modernih LLM modela, "razmišljanje" je postalo nova valuta. Međutim, trenutni trend reasoning modela često pati od ozbiljne inflacije: modeli troše hiljade tokena na repetitivne, "verbose" unutrašnje monologe čak i za trivijalne zadatke. Svaki taj suvišni token predstavlja direktan trošak—u vremenu, električnoj energiji i latenciji. Kao neko ko se bavi optimizacijom open-source ekosistema, retko viđam modele koji rešavaju ovaj problem bez žrtvovanja performansi.

Novi Qwen3.5-9B-Claude-4.6-Opus-Reasoning-Distilled-v2 je upravo taj redak izuzetak. On ne pokušava da natera model da "razmišlja više", već da uspostavi "ekonomiju razmišljanja", pretvarajući 9B parametara u vitku, logičku mašinu koja isporučuje vrhunske rezultate uz drastično manji kognitivni overhead.

Paradoks efikasnosti: Manje reči, više tačnosti

Najimpresivniji aspekt v2 iteracije nije samo to što je kraća, već koliko je postala "gušća" u smislu inteligencije. Analizom metrika vidimo da je prosečna dužina lanca misli (Chain-of-Thought) smanjena sa 2284 na 1778 karaktera—što je redukcija od 22.17%. U svetu gde se modeli često hvale dužinom svojih razmišljanja, ovo deluje kontraintuitivno.

Međutim, "smoking gun" dokaz ove efikasnosti leži u metrici HumanEval+ passes per 10k think chars, gde v2 beleži neverovatan skok od +28.48%. To znači da model ne samo da je brži, već je svaka reč koju "izgovori" unutar svog internog monologa značajno kvalitetnija i svrsishodnija.

"Razmišljati pametnije, a ne duže" (Think smarter, not longer) nije samo marketinški slogan, već tehnička realnost ovog modela. Postizanje veće preciznosti uz 20% manje tokena je "holy grail" za cost-to-quality optimizaciju.

Moć opšte logike nad specifičnim kodiranjem

Jedan od najfascinantnijih nalaza u v2 dokumentaciji je poreklo njegove snage. Model je treniran na preko 14.000 premium uzoraka (korišćenjem datasetova poput nohurry/Opus-4.6-Reasoning-3000x-filtered i Roman1111111/claude-opus-4.6-10000x) koji se primarno fokusiraju na opštu logiku, matematiku i dedukciju, a ne na specifično pisanje koda.

Ipak, v2 dominira na HumanEval i HumanEval+ benchmark-u. Kako? Odgovor leži u konceptu koji nazivamo Reasoning Scaffold (skela rezonovanja). Imitirajući strukturu razmišljanja Claude 4.6 Opus modela, v2 je usvojio logičke obrasce koji su univerzalno primenljivi. Ovo dokazuje fundamentalnu tezu moderne AI arhitekture: logika je temelj sintakse. Ako model savlada čistu logičku dedukciju, on će prirodno postati bolji programer, čak i bez direktnog "drila" nad Python bibliotekama. Ova "cross-task" generalizacija je ključni dokaz robusnosti ovog 9B modela.

Kraj suvišnih kognitivnih petlji

Ranije iteracije Qwen modela imale su tendenciju ka repetitivnom rezonovanju—često bi se "vrteli u krug" analizirajući iste premise. Verzija v2 donosi konkretan "behavioral fix" za ove redundantne interne petlje.

Zahvaljujući Unsloth AI framework-u, koji je omogućio brzu i preciznu finetune distilaciju, model sada usvaja strukturiraniji, hijerarhijski pristup. Nova struktura misli često počinje direktno: "Dozvolite mi da pažljivo analiziram ovaj zahtev: 1..2..3...". Ovim se eliminiše token-heavy over-analiza jednostavnih problema, čime se dobija model koji je "self-consistent" i stabilan čak i u kompleksnim, višestepenim operacijama.

Spas za lokalne mašine i autonomne agente

Zbog svoje optimizovane "think" trajektorije, v2 donosi najveću vrednost u tri specifična domena:

- Consumer-grade GPU i VRAM-constrained okruženja: Kraći lanci misli znače manje zauzeće memorije i manju latenciju. Za korisnike koji vrte modele lokalno na RTX 3060 ili 4070 karticama, ovo je razlika između "upotrebljivog" i "frustrirajućeg" iskustva.

- Agentic workflows (OpenClaw stil): U ekosistemima poput OpenClaw-a ili lokalnih autonomnih agenata, gde model mora da reši desetine malih pod-zadataka, ušteda u tokenima na svakom koraku radikalno ubrzava end-to-end proces. Manje suvišnog razmišljanja znači brži odgovor agenta.

- Skalabilni projekti i jednostavni problemi: v2 je dizajniran da ne troši resurse na trivijalne upite, što ga čini idealnim za deployment u sistemima gde je throughput (propusnost) kritičan faktor.

Benchmark dokazi: Stabilnost pod pritiskom

Rezultati testiranja potvrđuju da v2 predstavlja "strict upgrade" u odnosu na bazni Qwen3.5-9B model. Posebno je impresivno kako se model ponaša pod različitim temperaturama:

- Test Run 1 (T=0.2): Čak i u striktnom logičkom modu, model ostvaruje skok od +2.44 poena na HumanEval+ testu.

- Test Run 2 (T=0.6): Pri kreativnijem rešavanju problema, prednost raste na fantastičnih +5.50 poena na HumanEval+ testu.

Ovi podaci pokazuju da više ne moramo da biramo između brzine (ekonomičnosti) i preciznosti. v2 konzistentno isporučuje bolje rezultate dok troši preko 20% manje karaktera po rešenom zadatku.

Zaključak i pogled u budućnost

Qwen3.5-9B-Claude-4.6-Opus-v2 je dokaz da budućnost AI-ja nije nužno u većim modelima, već u pametnije strukturiranim podacima za trening. Kroz distilaciju inteligencije sa zatvorenih modela poput Claude-a u agilne open-source okvire, dobili smo alat koji je spreman za realnu produkciju.

Naravno, treba uzeti u obzir i ograničenja. Zbog fokusa na SFT (Supervised Fine-Tuning) u domenu rezonovanja, opšte "chitchat" sposobnosti modela mogu biti blago umanjene. Takođe, kao i kod svakog LLM-a, rizik od halucinacija postoji, pa je model prvenstveno namenjen za akademsko istraživanje i tehničku eksploraciju.

Ipak, v2 nas primorava da postavimo provokativno pitanje: Ako AI može postati 20% efikasniji samo boljom strukturom misli, koliko sirovog procesorskog vremena danas trošimo na suvišno "razmišljanje" trenutnih modela? U eri održivog računarstva, odgovor na ovo pitanje vredi milione tokena.

Izvor: Hugging Face

Komentari

Nema komentara. Šta vi mislite o ovome?