Kako veštačka inteligencija odjednom "progleda" (i šta to znači za nas)

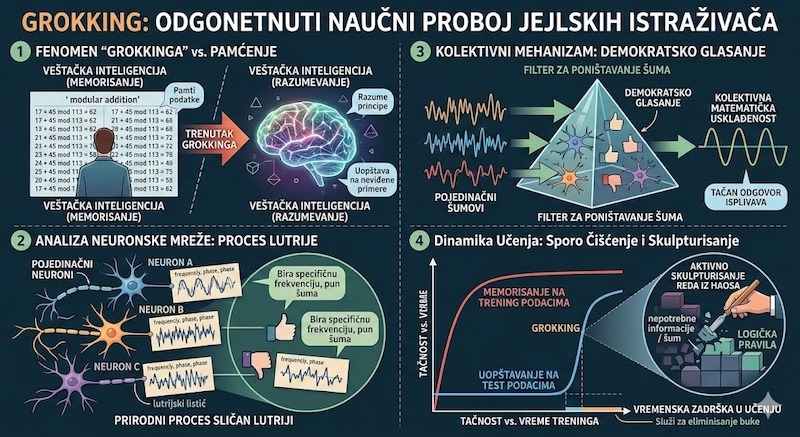

Zamislite neuronsku mrežu koja pokušava da savlada jedan fundamentalni matematički zadatak, poput modularnog sabiranja. Hiljadama koraka ona tapka u mestu; dok savršeno rešava primere koje je već videla, na svakom novom testu potpuno zakazuje, nasumično pogađajući rezultate. A onda se dešava nešto što u laboratorijskim uslovima deluje kao magija.

Bez ikakve promene u podacima, kodu ili arhitekturi, preciznost na testovima skače sa nule na skoro 100 procenata u samo nekoliko trenutaka. Kao da je neko unutar te "crne kutije" pritisnuo prekidač i mašina je odjednom "shvatila" suštinu.

Ovaj fenomen, poznat kao "grokking", prvi su dokumentovali istraživači iz OpenAI-ja 2022. godine. On je brzo postao jedna od najvećih misterija modernog dubokog učenja: svi su mogli da vide taj dramatičan skok, ali niko nije znao šta se zapravo dešava unutar mreže u tim dugim, "tihim" fazama pre samog klika. Nedavno je tim istraživača sa Yale-a konačno dešifrovao ovaj mehanizam, otkrivajući da se iza prividne tišine krije fascinantan matematički ples frekvencija i faza.

1. Neuroni koji pevaju: Fourierove transformacije kao ključ

Kada su istraživači sa Yale-a "otvorili" malu, dvoslojnu mrežu od 512 neurona koja je uspešno savladala modularno sabiranje, dočekalo ih je šokantno otkriće. Primenom diskretne Fourierove transformacije na parametre mreže, uspeli su da dekomponuju težine (weights) svakog neurona u frekvencijske komponente.

Rezultat nije bio haotičan niz brojeva, već čista, harmonijska struktura:

"Svaki pojedinačni neuron nakon treninga postao je čist kosinusni talas. Svaki neuron bira tačno jednu frekvenciju i zaključava se na nju, postajući čisti sinusoidalni signal na specifičnoj frekvenciji."

Ovo nam govori da mreža nije samo naučila tabelu sabiranja napamet. Ona je spontano otkrila fundamentalnu matematičku strukturu problema kroz frekvencije. Umesto da se oslanja na sirove brojeve, ona je problem prevela u jezik talasa, gde su rešenja modularne aritmetike prirodno kodirana u harmonijskim odnosima.

2. Lutrija koja se dobija pre prvog koraka

Pitanje koje se nameće je: kako neuron "zna" koju će od mnogih mogućih frekvencija da odabere? Istraživači su identifikovali specifičan "mehanizam lutrijskog listića" koji se značajno razlikuje od klasičnih hipoteza o orezivanju mreža.

Na samom početku, svaki neuron je "šum" – mešavina svih mogućih frekvencija malih amplituda i nasumičnih faza. Međutim, inicijalna stanja određuju pobednika. Istraživanje je pokazalo da stopa rasta svake frekvencijske komponente direktno zavisi od kosinusa faznog neslaganja (phase misalignment) između ulaza i izlaza.

Kada je faza slučajno dobro poravnata, kosinus je blizu jedinice, što pokreće eksponencijalno ubrzanje rasta te frekvencije. Ovde vlada nemilosrdni princip "bogati postaju još bogatiji": ona frekvencija koja je u blagoj prednosti na samom startu raste brže, što joj omogućava da dominira nad ostalima, dok ostali signali unutar tog neurona polako blede. Sudbina neurona je, matematički gledano, odlučena pre nego što trening uopšte uzme zamah.

3. Spontana demokratija: Glasanje kao matematički optimalno rešenje

Jedan neuron koji "peva" na jednoj frekvenciji nije dovoljan da reši problem; on nudi samo pristrasan i nepotpun uvid. Rešenje leži u onome što istraživači nazivaju "puna diversifikacija" – stanju gde mreža prirodno "otkriva demokratiju".

Mreža koristi stotine neurona koji pokrivaju različite frekvencije sa fazama koje su uniformno raspoređene. Svaki neuron daje svoj "glas" za konačni rezultat. Iako su pojedinačni glasovi bučni i sami po sebi neprecizni, kada se oni agregiraju širom mreže, šum se matematički poništava.

Ono što preostaje je ono što istraživači nazivaju "perfektna indikatorska funkcija" – signal koji nepogrešivo ukazuje na tačan odgovor. Fascinantno je da niko nije programirao ovaj demokratski sistem glasanja; mreža ga je sama izabrala kao matematički najefikasniji način za pretvaranje haotičnih signala u savršenu preciznost.

4. Grokking nije "Aha!" momenat, već lagano otkrivanje

Iako nama skok preciznosti deluje trenutno, "grokking" je zapravo trostepeni proces koji se aktivira samo pod određenim uslovima – preciznije, kada se deo podataka namerno uskrati (npr. odnos 75% trening podataka prema 25% test podataka) i kada se primeni weight decay (sila koja gura težine ka nuli).

- Strateška memorizacija: Mreža prvo brzo uči podatke napamet. Zanimljivo je da ona prioritet daje "simetričnim parovima" (primerima gde su i X+Y i Y+X prisutni u trening setu). Ona gradi "prljavo" rešenje koje radi za trening set, ali je puno šuma.

- Generalizacija (Čišćenje): Ovo je faza u kojoj se odvija prava borba. Dok gradijentni spust pokušava da zadrži tačnost, weight decay polako "oreže" sve što nije neophodno. On uklanja buku memorizacije i ostavlja samo čiste frekvencije koje su pobedile na početnoj lutriji.

- Spora konvergencija: Kada se šum ukloni, rešenje koje je već postojalo ispod površine konačno postaje vidljivo na testovima.

"Razumevanje je formirano sve vreme, samo ga nismo videli dok se šum memorizacije nije uklonio. Grokking nije naglo otkriće, već spori proces otkrivanja strukture koja je već bila tu, ali skrivena."

5. Univerzalnost algoritma: Više od običnog koda

Da li ovaj uspeh zavisi od specifičnih alata koje smo dali mašini? Istraživači sa Yale-a su testirali granice ovog fenomena zamenivši standardnu ReLU funkciju aktivacije potpuno drugačijim funkcijama, poput polinoma parnog reda (kvadratne funkcije ili polinomi četvrtog stepena).

Mreža je i dalje postizala savršenu preciznost. Ispostavilo se da algoritam koji mreža pronalazi ne zavisi od specifičnog dizajna, već eksploatiše inherentnu matematičku strukturu komponenti parnog reda. To nam govori da veštačka inteligencija pronalazi puteve do rešenja koristeći univerzalne matematičke istine koje su šire i dublje od samog koda u kojem su napisane.

6. ZAKLJUČAK: Šta možemo naučiti od neuronskih mreža?

Dešifrovanje grokkinga nam pokazuje da veštačka inteligencija nije samo "statistički papagaj" koji ponavlja obrasce. Kroz interakciju Fourierovih transformacija, početne lutrije frekvencija i kolektivnog glasanja, ona uspeva da destiluje red iz haosa.

Glavne lekcije ovog istraživanja su jasne:

- Red se gradi u tišini: Razumevanje često nastaje davno pre nego što postane vidljivo u rezultatima.

- Demokratija je matematički optimalna: Snaga leži u diversifikaciji i poništavanju individualnog šuma.

- Manje je više: Često je potrebno "ukloniti" nepotrebno (kroz weight decay) da bi se otkrila suština.

Ovo nas navodi na provokativno pitanje: da li je i ljudsko "razumevanje" možda sličan proces? Možda naši sopstveni trenuci prosvetljenja nisu stvaranje nečeg novog, već samo finalni čin uklanjanja šuma iz obrazaca koji su se dugo taložili u našim umovima. Grokking nas uči da je put do istinskog znanja popločan strpljenjem i rigoroznim čišćenjem nebitnog. Red će uvek nastati iz haosa, ako mu damo dovoljno vremena da se "očisti" od viška.

Komentari

Nema komentara. Šta vi mislite o ovome?