Kako da iz vašeg lokalnog AI dobijte odlične rezultate

Instalirali ste LM Studio ili Ollama, preuzeli hvaljeni model i sa uzbuđenjem ukucali prvi zadatak, očekujući iskustvo slično onom na ChatGPT-u. Umesto toga, dobili ste konfuzan, štur ili potpuno neupotrebljiv odgovor. Frustrirajuće je, zar ne? Mnogi korisnici u ovom trenutku odustaju, misleći da je sam model "glup" ili inferioran.

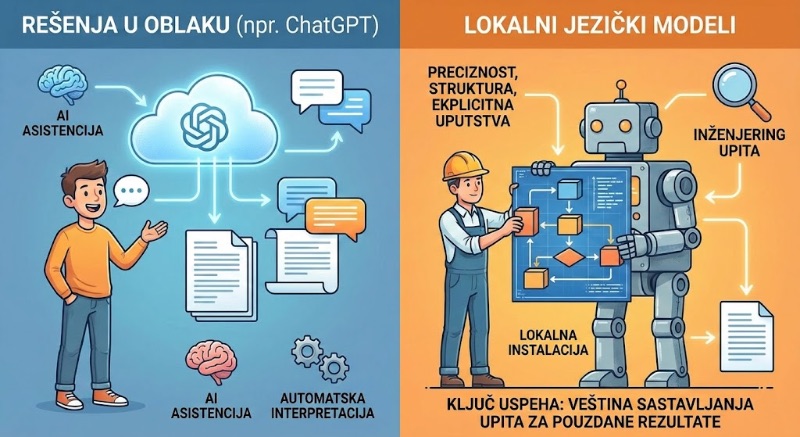

Međutim, problem najčešće nije u samom modelu, već u načinu na koji mu se obraćamo. Lokalni LLM-ovi (veliki jezički modeli) su moćni alati, ali oni ne poseduju "pomoćne slojeve" na koje su nas navikle cloud platforme. Da biste izvukli maksimum iz svog lokalnog hardvera, morate promeniti pristup i postati precizniji u komunikaciji.

Lokalni modeli nemaju "točkove za pomoć"

Kada koristite ChatGPT ili Gemini, vi ne komunicirate direktno sa "sirovim" modelom. Cloud platforme dodaju slojeve sistema iznad osnovnog modela koji pomažu u rezonovanju, pretraživanju informacija (RAG), korišćenju alata, pa čak i u simuliranju empatije. Lokalni setup, poput onog u LM Studio-u, obično preskače ove dodatke.

Kao što izvorni tekst naglašava:

„Lokalni modeli nemaju iste slojeve pomoći koje cloud modeli dodaju iza kulisa – oni se mnogo više oslanjaju na jasnoću onoga što im date.“

Zbog odsustva ovih dodatnih sistema, lokalni modeli su predvidljiviji, ali su istovremeno mnogo manje tolerantni na greške u vašim instrukcijama. Oni rade tačno ono što im kažete, bez pokušaja da "isprave" vašu nejasnu nameru ili popune praznine u logici.

Zamka bukvalnosti i ograničen nivo zaključivanja

Navika da sa AI-jem ćaskamo neobavezno, šaljući mu polovično definisane ideje, ne funkcioniše kod lokalnih modela. Ključni razlog je veličina: većina lokalnih modela je značajno manja od svojih cloud pandana. Manjim modelima nedostaje "inference scale" – masivni kapacitet zaključivanja koji omogućava ChatGPT-u da pogodi šta ste hteli da kažete čak i kada ste nejasni.

Lokalni LLM će vaš input shvatiti krajnje bukvalno. Ako je prompt nejasan ili gramatički netačan, on će se držati onoga što je napisano umesto da popunjava praznine.

Evo primere promptova koje treba izbegavati:

• "[umetnuti tekst]. Možeš li ovo popraviti?"

• "[umetnuti tekst]. Šta misliš o ovome?"

• "Pomozi mi da napišem nešto o lokalnim AI modelima."

• "Pretvori ove beleške u nešto čitljivo."

Lokalni model ne zna šta vi smatrate "boljim" ili "čitljivijim" osim ako mu to eksplicitno ne definišete u samom promptu. Savet eksperta: Ako vaš alat za pokretanje modela to dozvoljava, ove definicije (šta je za vas "dobar stil") možete postaviti u "System Prompt" kako biste ih trajno definisali za celu sesiju.

Fiksirani tegovi i granice memorije

Važno je razumeti tehničko ograničenje: kada pokrenete model kroz Ollama ili LM Studio, koristite pre-trenirani model čiji su tegovi (weights) fiksirani. To znači da model ne uči iz razgovora sa vama na duge staze, niti postepeno prilagođava svoje ponašanje vašem stilu tokom vremena.

On koristi samo takozvani "kontekstualni prozor" (context window) – memorijski limit u koji staje istorija vašeg trenutnog razgovora. Model može da koristi samo ono što stane u taj limit kako bi formulisao odgovor. Ako vaš početni prompt nije postavio jasne parametre i pravila, model se neće "sam od sebe" prilagoditi vašim očekivanjima. On ostaje identičan onome kakav je bio u trenutku kada je trening završen.

Rešenje je u strukturi i "Few-Shot" primerima

Da biste dobili kvalitetne rezultate, vaš prompt mora biti eksplicitan, specifičan i logički strukturiran. To je ono što nazivamo "programiranjem rečima".

Upotreba delimera i Markdown upozorenje

Koristite simbole poput ### ili --- kako biste modelu jasno razdvojili instrukcije, primere i podatke. Ipak, budite oprezni: ako vaš model ili runner (poput LM Studija) automatski forsira Markdown formatiranje, ovi delimiteri možda neće raditi kako je planirano. U tom slučaju, budite dosledni u tome koji simbol koristite za koju svrhu.

"Few-Shot" prompting (Učenje na primerima)

Najbolji način da vodite lokalni model je da mu date primere onoga što želite (i onoga što ne želite).

• Review: Ovaj restoran je bio neverovatan!

• Sentiment: Pozitivan

• Description: Boja atmosfere tokom vedrog dana.

• Object: Plavo nebo

• Input: Projekat kasni.

• Tone: Formalni.

• Output: Rokovi za realizaciju projekta su produženi.

Primer naprednog strukturiranog prompta

Evo kako izgleda profesionalni prompt za analizu UX istraživanja (testiran na modelu poput gpt-oss-20b u LM Studiju), koji koristi razbijanje zadatka na korake:

Task Instructions: Vi analizirate grube beleške iz UX istraživanja. Pažljivo pratite sledeće korake:1. Sumirajte glavne probleme korisnika u 3-5 tačaka.

2. Identifikujte prilike za poboljšanje ili funkcije koje bi proizvod mogao dodati.

3. Kategorizujte svaki predlog kao „Critical“, „Optional“ ili „Nice-to-have“.

4. Istaknite sve nejasne ili nepotpune beleške koje zahtevaju dodatno pojašnjenje.

Format Examples: Note: Korisnici kažu da aplikacija puca pri otpremanju slika. Pain Point: Pad aplikacije tokom uploada. Opportunity: Poboljšati stabilnost otpremanja. Priority: Critical.

Input Notes: [ovde nalepite svoje beleške]

Zaključak: Nova era prompt inženjeringa

Lokalni AI zahteva da postanemo bolji komunikatori. Dok cloud modeli često "opraštaju" lenjo pisanje, rad sa lokalnim modelima je zapravo pravi inženjering – vi morate aktivno voditi model do rezultata koji želite.

Lokalni modeli su izuzetno moćni, ali ne trpe pretpostavke. Da li ste spremni da prestanete da samo ćaskate sa svojim AI-jem i počnete da ga zaista programirate svojim rečima?

Izvor: xda-developers.com

Komentari

Nema komentara. Šta vi mislite o ovome?