Curenje izvornog koda Claudea: Analiza incidenta

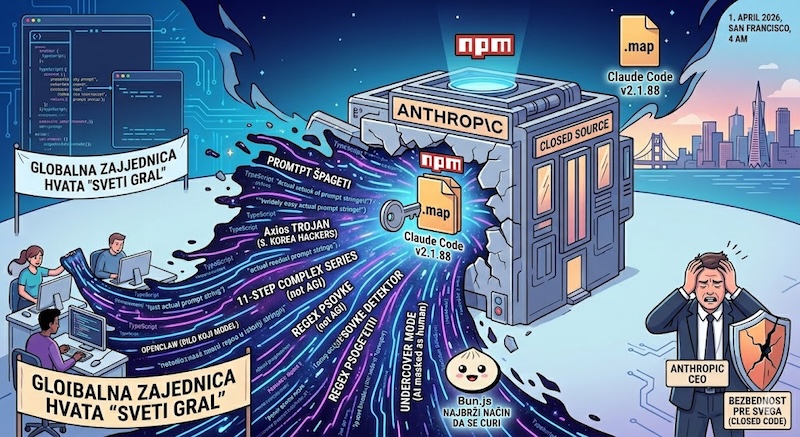

U svetu visoke tehnologije, ironija je često najmoćnije pogonsko gorivo, a Anthropic nam je upravo isporučio pun rezervoar. Zamislite scenu: 4 sata ujutru je u San Francisku, 1. april 2026. godine. Dok grad spava, kompanija vredna 380 milijardi dolara – ista ona koja propoveda "bezbednost pre svega", zagovara zatvoreni kôd i čiji CEO godinama upozorava da će nas AI zameniti za šest meseci – slučajno postaje "otvorenija" od OpenAI-a.

Kroz banalan propust pri objavljivanju na NPM ekosistemu (Node Package Manage je menadžer paketa za JavaScript i podrazumevani menadžer paketa za Node.js), verzija 2.1.88 paketa Claude Code isporučena je sa "source map" fajlom od 57 megabajta. Ovaj digitalni "Sveti gral" sadržao je preko 500.000 linija potpuno čitljivog TypeScript koda. Dok su se pravni timovi probudili da izdaju DMCA zahteve, kôd se već proširio poput šumskog požara. Zajednica je reagovala munjevito: projekat Claw Code je pomoću OpenAI modela već preveo ceo kôd u Python, postavši najbrže rastući repo u istoriji GitHuba, dok je OpenClaw učinio Anthropicovu tajnu tehnologiju kompatibilnom sa bilo kojim modelom, čineći njihovu ekskluzivnost potpuno obesmišljenom.

1. Najbrži put do katastrofe: Kako je Bun.js "pomogao" curenju

Tehnička pozadina ovog incidenta je vrhunac inženjerskog crnog humora. Claude Code je izgrađen na Bun.js, runtime okruženju koje je Anthropic nedavno kupio. Bun.js se reklamira kao "najbrži JavaScript runtime na svetu", a u ovom slučaju se pokazalo da je to zaista najbrži način da se čitava intelektualna svojina kompanije pošalje u etar.

Posebno boli činjenica da je na GitHubu još pre tri nedelje otvoren tiket koji upozorava na problem sa serviranjem "source map" fajlova u produkciji. Anthropic je svesno ignorisao poznatu ranjivost dok je istovremeno držao lekcije o globalnoj bezbednosti. Da stvar bude još gora po njihovu reputaciju, kôd je otkrio da Claude koristi paket Axios, koji su samo dan ranije kompromitovali severnokorejski hakeri. Zamislite kompaniju koja "štiti čovečanstvo", a unutar svog "sigurnog" sistema drži trojanca koji omogućava udaljeni pristup njihovim serverima. Kako kažu u industriji: vaša strogo čuvana tajna je uvek udaljena samo jedan nepažljiv NPM "publish" od toga da postane javno dobro.

2. Demistifikacija magije: "Špageti" od promptova i TypeScripta

Za sve koji su verovali u "vanzemaljsku inteligenciju" sakrivenu iza Claudea, procureli kôd je delovao kao hladan tuš. Umesto revolucionarnih algoritama, pronađen je "dinamički sendvič od promptova zalepljen TypeScriptom". Ono što smo smatrali magijom je zapravo kompleksna serija od 11 koraka (koju su entuzijasti već vibe kodirali u pregledne dijagrame) gde sistem koristi statistiku da, grubo rečeno, povrati podatke koje je prethodno pokrao sa interneta.

Unutar koda se nalaze beskonačni nizovi "hardcoded" instrukcija u obliku ogromnih stringova koji doslovno preklinju model da bude "dobar dečko" i da ne radi ništa čudno. Posebno dragocen ulov za konkurenciju je bash alat koji sadrži preko 1.000 linija koda za izvršavanje komandi. Ovaj fajl je bukvalno nacrt (blueprint) za kreiranje pouzdanog AI asistenta za programiranje, nešto što su konkurenti godinama pokušavali da repliciraju putem pokušaja i grešaka.

3. Digitalne "otrovne pilule": Rat protiv konkurencije

Anthropic nije samo gradio model; oni su gradili digitalne zamke. Procureli kôd je razotkrio "anti-distillation poison pills" – mehanizme dizajnirane da zaštite podatke od konkurenata (naročito kineskih laboratorija) koji pokušavaju da treniraju svoje modele na Claudeovim izlazima.

Strategija je podla koliko i genijalna: Claude u svojim odgovorima simulira korišćenje alata koji zapravo ne postoje. Ako konkurentski model uči na tim podacima, on počinje da halucinira o nepostojećim alatima, što direktno srozava njegove performanse i čini ga neupotrebljivim. Međutim, curenje je pretvorilo ovu "crnu kutiju" u otvorenu knjigu; sada distillerska zajednica tačno zna šta da filtrira, a Anthropicova "otrovna pilula" postala je običan digitalni placebo.

4. "Undercover Mode" i detektor psovki: Ljudskost po receptu

Dva otkrića posebno oslikavaju filozofiju kompanije koju Elon Musk naziva "Misanthropic":

- Undercover Mode: Set instrukcija koji nalaže Claudeu da se nikada ne identifikuje u "commit" porukama. Cilj je da kod koji generiše AI izgleda kao ljudski rad. Iako Anthropic tvrdi da je ovo mera protiv curenja imena modela, jasno je da je cilj dekapitacija provere – infiltriranje AI koda u open-source projekte bez dodatnog nadzora koji bi usledio da se zna da ga je pisala mašina.

- Regex detektor frustracije: Dok nam prodaju priču o "opštoj inteligenciji" (AGI), za detekciju korisničkog nezadovoljstva koriste tehnologiju staru pola veka. Običan Regular Expression (Regex) skenira vaše upite tražeći reči poput "fuck", "balls" i druge psovke kako bi logovao događaj. Dakle, "napredna svest" vas zapravo ne razume; ona samo upoređuje vaše reči sa listom nepoželjnih termina kao jednostavan skript iz devedesetih.

5. Budućnost skrivena u kodu: "Buddy", "Kairos" i mitski modeli

Kôd je prepun komentara koji, ironično, nisu pisani za ljude već da bi AI mogao da piše samog sebe u beskonačnoj petlji. U tim beleškama krije se i mapa puta koju Anthropic nije planirao da otkrije:

- Buddy: Digitalni saputnik, neka vrsta AI Tamagotchija kojeg programeri mogu da prilagođavaju i "odgajaju".

- Kairos: Ime potiče iz grčkog jezika i označava "Božje vreme" ili "pravi trenutak". Ironično je što Bog očigledno nije hteo da Anthropic sam izabere trenutak za objavu. Kairos je agent koji radi u pozadini, vodi dnevnik i koristi "Dream Mode" za konsolidaciju memorije dok vi spavate.

- Modeli i modovi: U kodu se pominju Opus 4.7, misteriozni model Capiara (verovatno famozni Mythos), kao i ekstremni modovi rada: "Ultra Plan Coordinator Mode" i zlokobni "Demon Mode".

6. Zaključak: Lekcija o krhkosti modernog softvera

Ovaj incident je kolosalan udarac za Anthropic, posebno pred planirani izlazak na berzu (IPO) gde su se nadali da će svoje "vreće" prebaciti na leđa malih investitora. Curenje je pokazalo da su njihovi sistemi, uprkos retorici o bezbednosti, zapravo "špageti od promptova" zaštićeni pogrešnim NPM konfiguracijama.

Postavlja se provokativno pitanje: koliko su zapravo sigurni naši zatvoreni sistemi ako se najnaprednija AI istraživanja sveta mogu razotkriti jednim klikom? Dok se Anthropic bori sa posledicama, industrija je naučila da "magija" nije ništa drugo do iluzija napravljena od starih programerskih koncepata i kradenih podataka. Granica između poslovne tajne i javnog dobra nikada nije bila tanja – niti ironičnija.

Komentari

Nema komentara. Šta vi mislite o ovome?